Künstliche Intelligenz (KI) gestaltet das Gesundheitswesen neu – von Diagnostik und Prävention bis hin zu klinischen Abläufen und Forschung. Wie stark dieser Wandel ausfällt, hängt jedoch entscheidend von hochwertigen Daten und einer sorgfältigen Prüfung im klinischen Umfeld ab.

Aktuelle Evidenz macht deutlich: Es gibt großes Potenzial, aber auch klare Grenzen. Kurzfristige Fortschritte zeigen sich vor allem dort, wo Daten strukturiert vorliegen und Outcomes messbar sind. Umfassendere Veränderungen erfordern dagegen robuste Regeln und Datenstandards, die Reproduzierbarkeit und Fairness gewährleisten. [1], [2]

Regulatorische Aktivitäten und klinische Einführung gewinnen zunehmend an Fahrt, insbesondere in der Bildgebung. Die U.S. Food and Drug Administration (FDA) veröffentlicht eine stetig wachsende Liste zugelassener KI-gestützter Geräte, wobei Radiologie die führende Disziplin bleibt. Metastudien weisen jedoch darauf hin, dass die berichtete Leistungsfähigkeit oft heterogen und zum Teil methodisch fragil ist – ein Hinweis auf die Notwendigkeit von Studien und eines kontinuierlichen Modellmonitorings. [3], [4], [5]

Dieser Artikel zeigt Ihnen, wie KI die Gesundheitssysteme weltweit schon heute verändert.

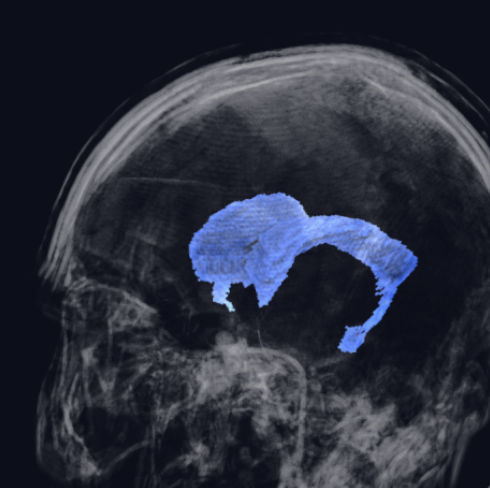

KI-gestützte Diagnostik und Bildgebung: schneller, smarter, präziser

KI-gestützte Mustererkennung verändert Radiologie und Pathologie grundlegend. Systematische Übersichten belegen, dass Deep-Learning-Systeme bei bestimmten Aufgaben (z. B. CT, MRT, Histopathologie) eine Leistung auf Expertenniveau erreichen können. Zugleich weisen sie aber auf Bias-Risiken und variable Berichtsqualität hin. Das bedeutet: Ergebnisse im Forschungskontext lassen sich nicht automatisch auf den klinischen Alltag übertragen, solange eine strenge Validierung fehlt. [4], [5]

In der Praxis steht daher die Unterstützung von Fachkräften im Vordergrund, nicht ihre Ablösung. Studien aus der Radiologie deuten darauf hin, dass Mensch und KI gemeinsam bessere Ergebnisse erzielen können als jede Seite allein – vorausgesetzt, Arbeitsabläufe berücksichtigen KI-Fehler und sichern den menschlichen Kontext sowie die Aufsicht. Anders gesagt: Zusammenarbeit funktioniert, wenn sie technisch und organisatorisch gut durchdacht ist. [6]

Am Markt zeigt sich dieses Prinzip ebenfalls: Die meisten zugelassenen Anwendungen dienen der Detektion und Triage, nicht der autonomen Diagnose. Regulatoren setzen klar auf Sicherheit und Transparenz bei der Entscheidungsunterstützung. [3]

Prädiktive Analytik und frühe Krankheitsentdeckung in Public Health

Analysen auf Bevölkerungsebene kombinieren elektronische Gesundheitsakten (EHRs), soziale Faktoren, Genomdaten und Signale von Wearables, um Risiken zu identifizieren und präventive Maßnahmen einzuleiten. Dieser Ansatz folgt internationalen Initiativen, biomedizinische Daten FAIR und KI-fähig zu machen. [2], [11]

Studien mit Wearables zeigen, dass Abweichungen vom individuellen Normalwert (z. B. Herzfrequenz, Schlaf, Temperatur) Infektionen oder physiologischen Stress anzeigen können, bevor Symptome auftreten. So lassen sich Tests, Isolierungen oder proaktive Versorgung früher umsetzen. Allerdings bleiben diese Signale Zusatzinformationen: Sensitivität und Spezifität schwanken je nach Kohorte und Algorithmus, und Versorgungspfade müssen Fehlalarme minimieren. [8]

Die Praxis bestätigt: Real-World-Validierung ist unverzichtbar. Ein weit verbreitetes Sepsis-Modell schnitt bei externer Überprüfung deutlich schwächer ab – ein Beispiel dafür, wie Standortfaktoren, Datendrift und unklare Labels die Genauigkeit außerhalb der Entwicklungsumgebung beeinträchtigen. Das unterstreicht die Notwendigkeit prospektiver, transparenter Prüfungen und kontinuierlichen Monitorings, bevor eine automatisierte Hochrisiko-Anwendung eingeführt wird. [10]

KI in Remote Patient Monitoring und Digitalen Therapeutika

Fernpatientenüberwachung (Remote Patient Monitoring, RPM) verbindet Sensoren mit Algorithmen, um Verschlechterungen frühzeitig zu erkennen, individuelles Feedback zu geben und die Versorgung chronischer Erkrankungen zu unterstützen. In der Kardiologie fassen Übersichtsarbeiten den Nutzen kontinuierlicher Messungen und Analysen etwa bei Rhythmusstörungen, Blutdruckverläufen oder Rehabilitationsmonitoring zusammen. Diese Methoden sind besonders dann vielversprechend, wenn sie mit ärztlicher Aufsicht und validierten Endpunkten kombiniert werden. [7]

Digitale Therapeutika (DTx) setzen noch einen Schritt weiter an: Sie übertragen diesen Ansatz in regulierte Software-Interventionen. Branchenstandards und politische Empfehlungen fordern hier geprüfte Studienergebnisse, passende Zulassungen und Real-World-Evidenz – insbesondere, wenn KI-Module Inhalte oder Dosierungen dynamisch anpassen. [12]

Unterstützend wirken Forschungsplattformen, die Sensordaten „analysebereit“ machen. So bereitet das SensorHub-Programm von Data4Life Daten aus Wearables und Sensoren speziell für Forschung und Studienbetrieb auf – mit Fokus auf Interoperabilität und Durchführung, nicht auf klinische Diagnosen. [9]

Ethische KI, Bias-Minderung und regulatorische Rahmenwerke

Eine verantwortungsvolle Einführung von KI setzt klare Regeln voraus: Transparenz, Rechenschaftspflicht, Maßnahmen gegen Bias und konsequenten Datenschutz. Leitlinien der WHO formulieren Grundprinzipien für sichere und gerechte KI, mit Betonung auf menschlicher Aufsicht, hochwertiger Datenverwaltung und Schutz vor Diskriminierung. Ergänzend macht Forschung zur Erklärbarkeit Modelle nachvollziehbar für Ärzt:innen und Prüfer:innen. [13], [14]

Auch auf regulatorischer Ebene verdichten sich die Vorgaben. In der EU beschreibt das Reflection Paper der EMA die Erwartungen an KI über den gesamten Arzneimittellebenszyklus – von der Studienplanung bis zur Pharmakovigilanz. Der EU AI Act ergänzt dies mit risikobasierten Pflichten zu Datenqualität, Dokumentation und Post-Market-Monitoring, die mit branchenspezifischen Regelungen wie der Medizinprodukteverordnung zusammenwirken. Gesundheitsdaten fallen zudem unter die besonderen Schutzkategorien der DSGVO, während Informationssicherheitsstandards wie ISO/IEC 27001 die organisatorische Vorbereitung stärken. [15], [16], [17], [23]

Operative KI: Klinikmanagement und Workflows optimieren

Abseits der Patientenversorgung kann KI auch die Krankenhauslogistik effizienter machen – von der Triage in Notaufnahmen bis zur Prognose von Aufnahmen. Studien und Übersichten zeigen Leistungsgewinne für KI-gestützte Triage und interpretierbare Risikoscores, wenn sie prospektiv geprüft und in Eskalationspläne sowie menschliche Aufsicht integriert sind. [21], [22]

Auch die Ressourcenplanung verändert sich: Statt starrer Verteilungsquoten ermöglichen prädiktive Modelle und Optimierungsansätze eine dynamische Steuerung. Forschung kombiniert etwa Prognosen zur Verweildauer mit Optimierungsframeworks, um Bettenzuteilung und Durchsatz zu verbessern. Dabei gilt: Erfolge sind nur möglich, wenn ethische Standards, Personalvorgaben und Reserven für Belastungsspitzen berücksichtigt werden. [21]

Ausblick: KI in Wirkstoffentwicklung und Systemmedizin

In Forschung und Entwicklung wirkt KI entlang der gesamten Pipeline – von der Zielidentifikation über Moleküldesign und Syntheseplanung bis hin zu Studienoptimierung und Sicherheitsüberwachung. Übersichtsarbeiten dokumentieren Fortschritte, aber auch offene Lücken: Es braucht mehr experimentelle Validierung, kausale Methoden und prospektive Evidenz, die rechnerische Verbesserungen in klinischen Nutzen übersetzt. [18]

Multimodale Ansätze, die Strukturen, Omics, Literatur und Wissensgraphen (z. B. KEDD) zusammenführen, zeigen, wie heterogene Evidenzquellen zu robusteren Vorhersagen führen können – auch unter den Bedingungen realer Daten. Ziel ist es, über enge Benchmarks hinaus zu einem systemischen Verständnis in der Pharmakologie zu gelangen. [19]

Ethische Aspekte – von Erklärbarkeit und Datenherkunft bis hin zu gerechtem Zugang – müssen dabei von Anfang an berücksichtigt werden. Wissenschaftliche und politische Stimmen betonen die Notwendigkeit einer „prinzipiengeleiteten Ingenieurspraxis“, um sicherzustellen, dass Beschleunigung nicht auf Kosten von Sicherheit, Fairness und Vertrauen geht. Querschnittsanalysen zeigen zudem: Der KI-Einsatz wächst zwar, bleibt aber ungleich verteilt – ein Grund mehr für robuste Standards. [20], [24]

Die Inhalte dieses Artikels geben den aktuellen wissenschaftlichen Stand zum Zeitpunkt der Veröffentlichung wieder und wurden nach bestem Wissen und Gewissen verfasst. Dennoch kann der Artikel keine medizinische Beratung und Diagnose ersetzen. Bei Fragen wenden Sie sich an Ihren Allgemeinarzt.

Ursprünglich veröffentlicht am